在人工智能蓬勃发展的今天,GPU(图形处理器)已从专精于图像渲染的硬件,蜕变成为驱动AI模型训练与推理的核心引擎。其重要性不仅体现在惊人的并行计算能力上,更延伸至对整个数据处理和存储支持服务生态的关键支撑。理解GPU为何在AI训练中不可或缺,以及它如何与数据处理和存储服务协同工作,是把握现代AI基础设施脉络的关键。

一、GPU:AI训练的算力基石

AI模型,尤其是深度神经网络,其训练过程本质上是海量矩阵和张量运算的迭代。这一过程对算力提出了近乎贪婪的需求。GPU的架构设计恰恰完美匹配了这一需求:

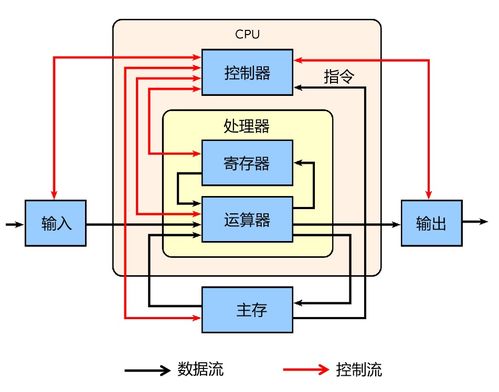

- 大规模并行架构:与CPU(中央处理器)少数几个为通用任务优化的高性能核心不同,GPU拥有成千上万个更小、更节能的核心。这些核心能够同时处理大量相似的计算任务,例如对训练数据批处理中的每一个样本进行相同的数学运算。这种“单指令多数据流”(SIMD)模式,使得GPU在处理图像、视频及神经网络中的张量数据时,效率远超CPU。

- 高吞吐量与专用硬件:现代GPU(如NVIDIA的Tensor Core、AMD的Matrix Core)集成了专为矩阵乘法与卷积运算设计的硬件单元,这些正是深度学习中最核心的操作。它们能以极高的吞吐量和能效执行混合精度计算,将训练时间从数周缩短至数天甚至数小时,极大地加速了模型迭代与研发进程。

- 软件生态的成熟:以CUDA和ROCm为代表的并行计算平台,为开发者提供了将计算任务映射到GPU海量核心上的工具链。结合TensorFlow、PyTorch等主流深度学习框架,研究人员和工程师能够高效地利用GPU算力,而无需深入底层硬件细节。

可以说,没有GPU提供的强大并行算力,当前基于大模型(如LLM、扩散模型)的AI革命将无从谈起。

二、从数据处理到存储:GPU生态的延伸支撑

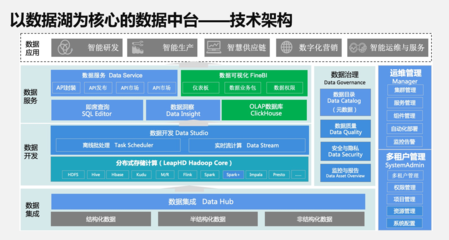

GPU的卓越性能并非孤立存在,它的高效发挥依赖于一套完整的数据处理与存储支持服务体系。这个体系确保了“燃料”(数据)能够持续、高速地输送到“引擎”(GPU)中。

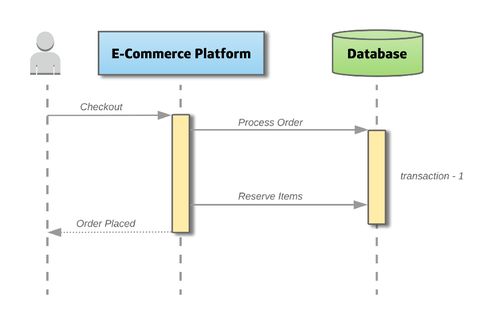

- 数据预处理与加载的流水线:在训练开始前,原始数据(文本、图像、音频等)需要经过清洗、标注、增强、归一化等预处理步骤。这些步骤本身也日益依赖GPU进行加速(如使用DALI等库)。更重要的是,训练过程中,数据需要从存储系统快速加载到GPU显存。这里,高速I/O(输入/输出)和智能数据加载器至关重要。它们需要能够:

- 匹配GPU算力:避免GPU因等待数据而空闲(“饥饿”现象)。这通常通过多进程/线程预取、使用高性能存储(如NVMe SSD)以及优化数据格式(如TFRecord、LMDB)来实现。

- 支持大规模数据集:对于TB甚至PB级的数据集,数据存储和管理服务必须提供高带宽、低延迟的访问能力。

- 存储系统的关键角色:存储是AI训练流水线的起点和终点。它需要满足:

- 容量与可扩展性:容纳不断增长的原始数据集、中间检查点以及最终训练好的模型。

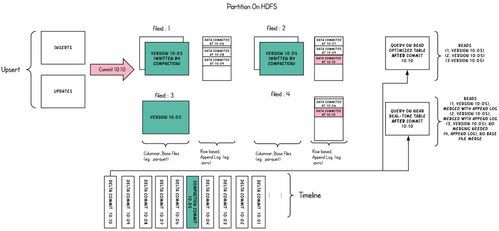

- 性能与并发性:当多个GPU服务器(乃至成千上万个,如在超大规模训练中)同时访问存储系统读取数据或保存检查点时,存储系统必须提供极高的聚合带宽和IOPS(每秒读写操作次数)。分布式文件系统(如Lustre、GPFS、WekaIO)或对象存储(如Amazon S3,常与缓存层配合)常被用于此场景。

- 数据管理与版本控制:服务需要帮助团队管理不同版本的数据集、训练代码和模型,确保实验的可复现性。

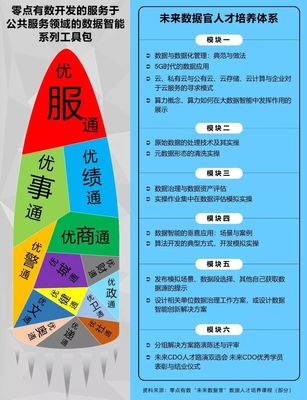

- 与云服务和混合架构的集成:公有云厂商(如AWS、GCP、Azure、阿里云)提供了强大的GPU实例,并通常将其与高性能块存储、文件存储、对象存储及大数据处理服务(如Spark)深度集成。这种“GPU即服务”的模式,结合弹性伸缩的存储,使得企业和研究机构能够按需构建从数据处理、模型训练到部署的完整流水线,而无需管理底层硬件。

三、协同进化的生态系统

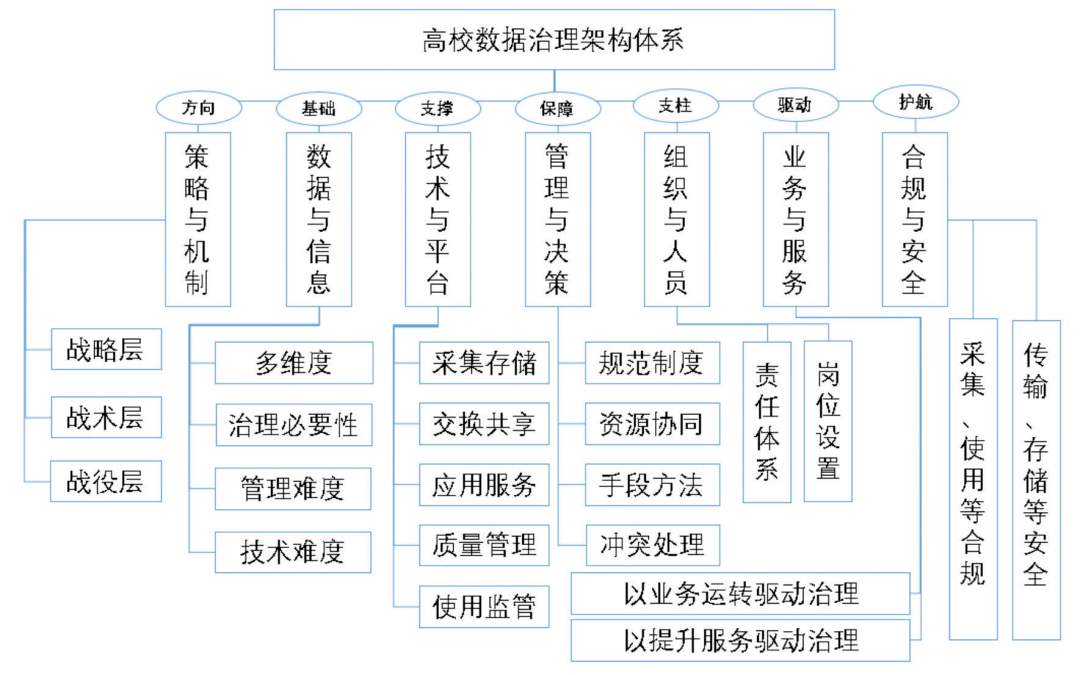

GPU在AI训练中的不可或缺性,已从单纯的“计算芯片”概念,扩展为一个以GPU为核心,包含高速互联(如NVLink、InfiniBand)、大容量高速存储、智能数据流水线以及优化软件栈的完整计算生态系统。

数据处理和存储支持服务是这个生态系统的“循环系统”和“仓库”。它们确保了海量数据能够被高效地准备、输送并归档,使得GPU这颗强大的“心脏”能够持续搏动,驱动AI模型不断学习与进化。随着模型规模和数据集复杂度的持续增长,GPU与存储、数据服务之间的协同优化将变得更加紧密,共同奠定下一代人工智能基础设施的基石。